現在進行中や過去のものも含めて、これまでに取り組んだ研究活動の一端をご紹介します。これまでの研究の詳細については業績リストを是非ご覧ください。

仮想と現実の融合

仮想現実(VR)や拡張現実(AR)といった言葉が一般にも浸透してきています。研究室でも長年にわたって同方向での取り組みを行ってきました。

例えば、透明スクリーン越しに見えている動物(のおもちゃ)を指さすと、利用者の目にはコンピュータによって生成された情報が重なって見えるような仕掛けを作りました。補足しておくと、必然と思われている画面枠(ウィンドウと言ってもよいのですが)というものがありません。そのおかげで仮想と現実という意識が自然と消滅する効果が生まれます。また、雪だるま(に見えないかもしれませんが)を指でつつくと、それが転ぶアクションが起こるようにしました。仮想と現実を融合するというのならば、仮想物体もまた現実物体と同様に触って操作できるべきですよね。

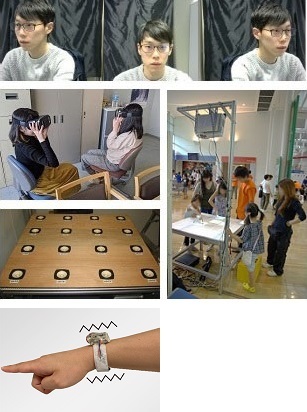

最近では、HMD(頭部搭載型のディスプレイ)を介して没入した仮想世界でのユーザの認知や行動は現実世界と同じなのか、といった疑問からスタートした研究に取り組んでいます。現実世界をそっくりそのまま仮想世界にコピー(モデル化)すれば、仮想世界での振る舞いは現実世界でのそれと同じになると鵜呑みにしている現実があります。本当にそうなのでしょうか?例えば、仮想世界にあっては、自分よりも頑強な身体(アバタ)を持つことだってあるわけです。お父さんに肩車してもらったときに見た世界は、いつもとは違う風景だったのではないでしょうか。身体の存在が我々の認識に影響を及ぼすことは知られた事実です。身体の大きさをヒトはどのように把握するかといった基礎的レベルの研究の他、自動車の運転を実応用に据えた応用志向の研究まで、いろいろと取り組んでいます。

また、建築分野のメンバーと連携して、学内環境の整備であったり、災害への備えといったシミュレーションを主な用途とする試みも始めています。

マルチモーダルな対話技術

アイコンに代表されるような視覚情報を対話手段(モダリティ)に用いることが全盛ですが、その他の対話手段も取り入れることで、利用者の操作性を高めようとする取り組みも盛んに行われています。

そのようなアプローチのひとつとして視線に着目しました。多くの場合はディスプレイ近くに配置したセンサデバイスを用いて視線検出がなされます。眼鏡型の装置も利用可能ですが、利用者にわざわざ装着してもらうといった煩わしさがあります。我々の研究室では、部屋の中にウェブカメラを複数設置し、それによって部屋の中にいる人の視線を追跡する技術の開発に取り組みました。また、そのような技術を活用した応用展開として、目を向けている興味対象を複数人の間で共有する提案も行いました。友達との間で、また恋人同士が言葉の代わりに、見ている風景を共有できたら世界が変わるかも、といった夢への挑戦です。

一方、2次元平面上の任意の位置から音が出ているように感じさせるテーブル型の装置を核に、テーブル上での利用者のジェスチャを捕捉し、適切な視覚的フィードバックも提示できる対話システムを実現しました。テーブルを囲んで参加している全ての人たちが、それぞれの立ち位置に係らず、位置を含めた音の情報を共有できることを目指しました。

また、VR空間では視覚が中心ですが、それだけではリアリティに乏しいため、触覚を提示するための小型のデバイスを開発したりもしました。触って感じることができるって、楽しくないですか?

ジェスチャの活用

ジェスチャ操作はとても魅力的なインタラクション技法であり、画面上で指を動かして操作するスタイルはスマートフォンの普及とともに日常的になってきました。これに対して私たちは、より直感的で分かりやすいインタフェースのひとつとして、手足ジェスチャを取り込むことにチャレンジしました。

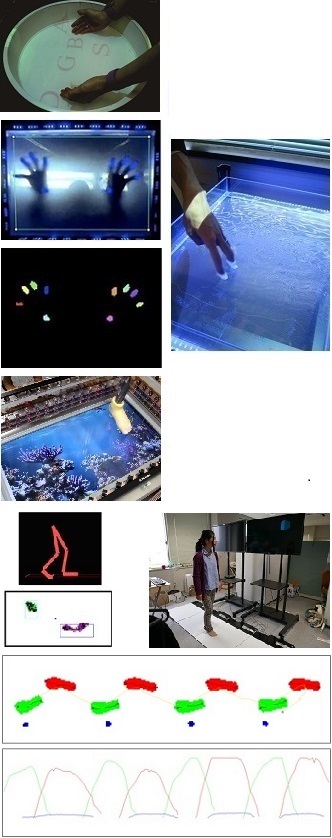

まず手のジェスチャ利用に際して、人間にとってごく身近な水を媒体に用いることを提案しました。利用者は手指を水につけてジェスチャを行えば、その動作に応じたシステム操作を行うことができるようになっています。最初は水槽の上に設置したカメラを使ってジェスチャを取得するようにしていました。水平・深さ方向の3次元位置を取得できるようにしました。水面に浮かぶアルファベットをすくうと、そのアルファベットで始まる単語を表すイラストイメージに変わったり、美しく光り輝くアニメーションに音楽をあわせたコンテンツを提供することもできます。その後、水に浸けた足のジェスチャを取得するようなシステムの開発にも取り組みました。足湯を主な用途に据えた上で、一般的な足湯の癒し効果に加え、人々の関心を引き寄せるコンテンツを提示することも可能です。

次に我々が着目したのは歩行です。二足歩行は私たち人間を他の動物から区別する極めて特徴的な特性です。これまでは裸足で歩くことが求められたり、あるいは靴に特別な道具を装着する必要がありました。我々は床面に敷いたマット状のセンサを用い、靴を履いた状態の歩行領域を個々に切り出して追跡することができるような手法を開発しました。靴裏の形状はさまざまですが、ひとつひとつの足領域をまとめて捉えるところに苦労がありました。複数人がひとつのマット状を同時に歩いても、あるいは杖を携えて歩いていても、それぞれの接地状況を捉えることができます。変形性膝関節症の患者を対象に、歩行特徴から膝の健常度を評価することができることを実験で明らかにしました。また、高齢者の転倒予防に用いるべく、デイケアセンターの協力を得ての研究も遂行しました。それらの他にも、足領域データから歩行者の下肢の動きの推定、歩行特徴からの感情の推定、さらに歩行者に追従してコンテンツを提示するようなディジタルサイネージの開発も行いました。

アプリケーション志向のトライアル

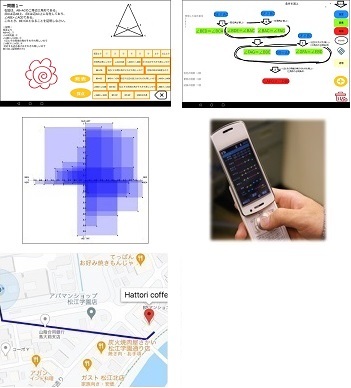

まずは教育関係のトライアルとして、Moodleという学習管理システムの機能拡張に取り組みました。特徴は、学習する個人個人の学習特性を踏まえ、提示する内容を変えることです。それを実現するために、Felder-Silvermanが提唱したモデルを基礎にして、Moodle上での操作記録(ログ)を機械学習させることによって、各人の学習スタイルを特定する機能を実装しました。

また図形の証明問題の分野に焦点を当て、タブレット端末を用いた能動的学修支援のためのシステム開発も行いました。タブレット端末などの情報機器は個人学習に偏りがちですが、協働的な学修にも利用できることに力点を置いた取り組みです。

教育以外の取り組みを紹介します。そのひとつとして、自転車の利用者のためのナビゲーションシステムがあります。特徴としては予め目的地を設定した上で最短距離を走行するようにナビゲーションするというのではなく、自由気ままに走っている途中で、例えば体調に変化があったときに近くの休憩場所に誘導したりするといったように、特に健康を志向した人々への一助となるようなシステムを目指しました。

また、人工透析患者に対し、自らの体調管理に意識を向けてもらうことでQOL(Quality of Life)の改善を実現することを目指したソフトウェアの開発もおこないました。携帯電話上で体調管理が一見して分かるような可視化を図った他、日常生活に係る情報の記述と患者自らの対応などを加味して、タイムリーかつ有益な支援の実現を図りました。

マルチメディアに係る取組み

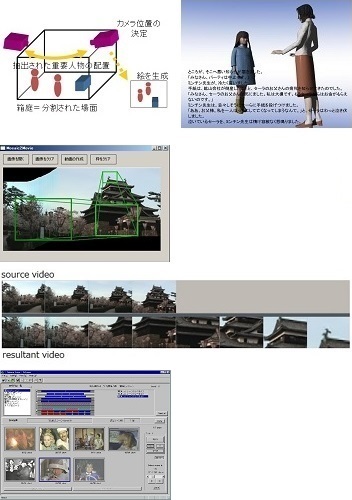

人間はメディア情報をどのように解釈しているのか、という疑問に答えを出すべく、そのメカニズムを明らかにする研究に取り組みました。そのひとつとして、物語テキストを入力すると、見開きページに相当する小片の段落にテキストを分割し、主人公や脇役を特定した後、それらを箱庭に配置しカメラワークを決定するという手順を踏んで、ページごとに対応する挿絵を自動生成し、一冊の絵本にまとめてくれるシステムを開発しました。

一方、ビデオは今日の生活に密着したメディアとしての地位を確保しており、その編集や検索のための技術についても検討しました。例えばビデオ編集にあっては、その多くは必要なショットを切り出し、そしてつなぎ合わせるという機能しかありません。我々はカメラワークに注目し、撮影後に自在にカメラワーク(パンニングとズーミング)を変えることを可能にする新たなビデオ編集技術を実現しました。

また同技術を用いて、カメラワークに基づいた映像シーンの検索であったり、映画の編集技法に基づいたビデオ検索システムも開発しました。例えば、ショット長を徐々に短くしたショットを提示することで緊張感を高めることができることが知られています。それらを逆に利用することで、緊迫あるいは重苦しいなどといったシーンを検索することを可能にしています。

状況指向&情報可視化

人間が活動を行っている地点位置や時刻といった状況を獲得し、そのデータを踏まえることで、より的確な支援を行うような枠組みを考案しました。また、LINEのようなメッセンジャーアプリも開発したことがあります。特徴的な点は、近くにいる人とだけメッセージを交換することができるようにしたことです。例えばスポーツやイベントで集まった同じ興味関心を共有する仲間との間でディープな話題共有ができたら、といった発想から生み出したものです。その場から離れると通信できなくなるのですが、意気投合した人と改めて出会う(近くに集まる)ことがあれば、そのことを通知することができるような機能も提供しました。

併せて、らせん形状を用いた時系列データの3次元可視化ツールを開発しました。ユニークな点は、データに内在する事象の周期性に注目し、その特徴が判別できるような可視化機能を提供していることです。事象が一列に並ぶように、らせんの直径を適宜調整することで、結果としてうねりを持ったらせん形状が形成されることになります。この形状を一目見ることで、一定周期性ごとに規則的に事象が発生しているのか、特定のパターン(例えば発生周期にある特徴的なゆれがある)を有しているのか、といったことが視覚的・直感的に理解できます。

ビジュアルプログラミング

ビジュアルプログラミングは、文字によるプログラム記述へのアンチテーゼともいえる取り組みです。アイコンを画面上に配置することで視覚的にプログラムを作成することができるHI-VISUALと名づけたシステムを開発しました。これはビジュアルプログラミングの先駆的な取り組みとして海外でも広く認識されたものでもあります。最近は小中学生へのプログラミング教育がうたわれ、ScratchやVISCUIT、島根発のスモウルビー(Smalruby)などのビジュアルプログラミングシステムが出現していますが、それらの源流にあるというと言いすぎでしょうか。

また、デモンストレーションによってプログラムを記述することができるPrograming-by-Demonstrationの研究も行いました。今でいうところのロボティック・プロセス・オートメーション(RPA)です。

また、ビジュアルプログラミングという範疇では必ずしもありませんが、あいまいな問い合わせを受けつけることができるデータベースシステムとして開発したARESでは、画面上に表示した表(リレーション)の中に問い合わせ条件を視覚的に記述することができます。視覚的な記述というアイディア自体はQBE(Query-by-Example)と呼ばれるものですが、「○○に近い」とか「○○ぐらい」といった条件記述の取り込みは、人にやさしいコンピュータシステムの開発に打ち込むようになった発端です。